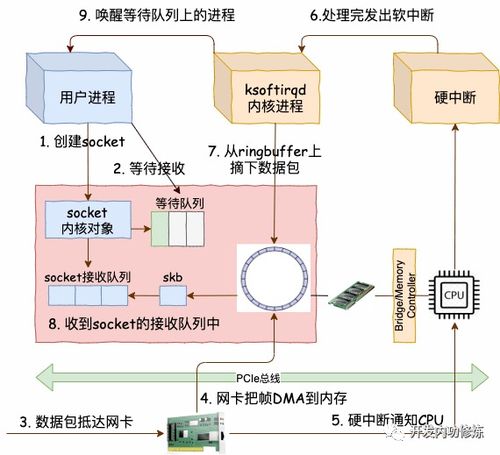

在追求高性能網(wǎng)絡(luò)服務(wù)的道路上,開發(fā)者常常會遇到一個基礎(chǔ)卻影響深遠(yuǎn)的挑戰(zhàn):同步阻塞網(wǎng)絡(luò)I/O。它如同潛伏在開發(fā)初期的“絆腳石”,理解其機(jī)制對于構(gòu)建穩(wěn)健、高效的網(wǎng)絡(luò)應(yīng)用至關(guān)重要。本文將通過圖解和解析,深入探討同步阻塞I/O的工作原理、其對性能的影響,并延伸至網(wǎng)絡(luò)運營層面的思考。

一、什么是同步阻塞網(wǎng)絡(luò)I/O?

我們可以用一個生動的“餐廳點餐”模型來圖解:

- 場景比喻:應(yīng)用程序(顧客)調(diào)用

read()或accept()等I/O操作(點餐)。 - “同步”:顧客發(fā)出點餐請求后,必須停留在柜臺前等待,不能離開去做其他事(程序線程在此處等待,不返回)。

- “阻塞”:直到廚師準(zhǔn)備好菜品(內(nèi)核將網(wǎng)絡(luò)數(shù)據(jù)準(zhǔn)備好并拷貝到用戶空間緩沖區(qū)),顧客拿到菜品后,才能離開柜臺進(jìn)行下一步(函數(shù)調(diào)用返回,程序繼續(xù)執(zhí)行)。

在這個過程中,調(diào)用線程會被完全掛起,占用著系統(tǒng)資源(如內(nèi)存)卻“無所事事”,直到整個I/O操作完成。

二、圖解:它如何成為性能“絆腳石”?

線程A: [發(fā)起read請求] ————> [阻塞等待數(shù)據(jù)]…(等待網(wǎng)絡(luò)延遲、對端響應(yīng))…[收到數(shù)據(jù),繼續(xù)處理]

↑

└——— 在此期間,線程A被完全占用,無法響應(yīng)其他連接或任務(wù)。核心問題可視化:

1. 資源浪費:每個并發(fā)連接都需要一個獨立的線程或進(jìn)程來處理。當(dāng)連接數(shù)暴漲(如C10K問題),線程數(shù)量急劇增加,導(dǎo)致大量的內(nèi)存消耗(每個線程都有獨立的棧空間)和劇烈的上下文切換開銷,CPU效率大幅下降。

2. 可伸縮性差:系統(tǒng)性能隨著連接數(shù)增加呈直線下降,甚至崩潰。因為操作系統(tǒng)能創(chuàng)建的線程數(shù)是有限的。

3. 延遲敏感:即使某個連接的數(shù)據(jù)沒有準(zhǔn)備好,處理它的線程也會阻塞,導(dǎo)致其他已經(jīng)準(zhǔn)備好數(shù)據(jù)的連接也必須等待,整體響應(yīng)時間變長。

三、從開發(fā)到運營:更深層的影響

這塊“絆腳石”的影響不僅限于代碼層面,更會直接投射到網(wǎng)絡(luò)運營中:

- 運維成本高昂:為了支撐一定的并發(fā)量,不得不橫向擴(kuò)展服務(wù)器實例(“堆機(jī)器”),直接增加了硬件成本、機(jī)房空間和電力消耗。

- 服務(wù)穩(wěn)定性風(fēng)險:在流量洪峰時,阻塞模型容易導(dǎo)致線程池耗盡,新的連接請求被拒絕或超時,表現(xiàn)為服務(wù)雪崩。運維人員面臨的突發(fā)擴(kuò)容壓力和故障恢復(fù)壓力巨大。

- 監(jiān)控與診斷復(fù)雜:當(dāng)系統(tǒng)性能下降時,原因可能是網(wǎng)絡(luò)延遲、對端服務(wù)慢或自身處理慢。在阻塞模型下,這些因素全部交織在一起,線程堆棧信息可能都顯示在“等待網(wǎng)絡(luò)I/O”,難以快速定位瓶頸所在。

- 資源利用率不均衡:CPU、內(nèi)存、網(wǎng)絡(luò)帶寬這三種關(guān)鍵資源無法被高效協(xié)同利用。經(jīng)常出現(xiàn)CPU空閑(因為線程都在阻塞等待I/O)但連接數(shù)已滿的尷尬局面,資源利用率低下。

四、跨越“絆腳石”:主流解決方案與運營收益

認(rèn)識到問題后,社區(qū)發(fā)展出了高效的跨越方案:

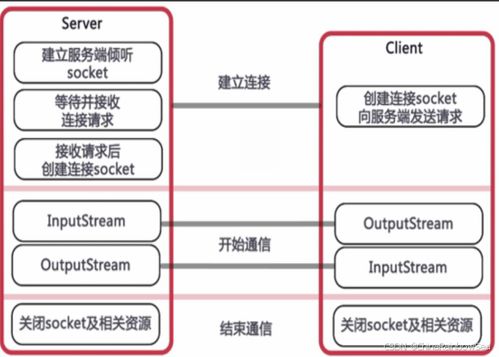

- 非阻塞I/O + I/O多路復(fù)用 (如 select/poll/epoll, kqueue):

- 圖解:一個“服務(wù)員”(單個線程)管理多個餐桌(Socket連接)。服務(wù)員輪詢或由系統(tǒng)通知哪些餐桌的菜準(zhǔn)備好了(I/O就緒),然后只處理那些準(zhǔn)備好的請求。

- 運營收益:單機(jī)可承載數(shù)萬甚至數(shù)十萬并發(fā)連接,極大降低硬件和運維成本。資源(尤其是CPU)利用率顯著提升。

- 異步I/O (AIO):

- 圖解:顧客點餐后立刻離開柜臺(函數(shù)調(diào)用立即返回),等餐食完全準(zhǔn)備好后,餐廳會主動送餐上門(通過信號或回調(diào)函數(shù)通知程序)。

- 運營收益:將資源利用推向極致,特別適合處理大量長尾、低速連接,為高并發(fā)、低延遲的精細(xì)化運營提供技術(shù)基礎(chǔ)。

- 協(xié)程 (Coroutine):

- 圖解:在用戶態(tài)實現(xiàn)輕量級“線程”調(diào)度。當(dāng)遇到I/O阻塞時,由運行時系統(tǒng)自動掛起當(dāng)前協(xié)程,切換到其他就緒的協(xié)程執(zhí)行,從而用同步的代碼風(fēng)格實現(xiàn)異步的性能。

- 運營收益:降低了高并發(fā)編程的心智負(fù)擔(dān)和出錯概率,提升了開發(fā)迭代速度,使團(tuán)隊能更專注于業(yè)務(wù)邏輯和運營策略。

五、

同步阻塞網(wǎng)絡(luò)I/O模型因其編程簡單直觀,常是入門之選。但在高性能網(wǎng)絡(luò)開發(fā)與運營的征途上,它確實是第一塊必須被清醒認(rèn)識并跨越的“絆腳石”。

對于開發(fā)者,深入理解其阻塞本質(zhì),是學(xué)習(xí)NIO、Netty、Go goroutine、Redis/NGINX事件驅(qū)動模型等高效框架的基石。

對于網(wǎng)絡(luò)運營者,理解底層I/O模型對系統(tǒng)資源利用率和擴(kuò)展性的根本性制約,有助于做出更合理的技術(shù)選型、容量規(guī)劃和故障預(yù)案。選擇或構(gòu)建一個基于非阻塞/異步I/O的高并發(fā)服務(wù)框架,往往意味著更低的單位請求成本、更優(yōu)的流量承載能力和更穩(wěn)健的服務(wù)體驗,這正是在激烈的數(shù)字運營競爭中贏得優(yōu)勢的關(guān)鍵技術(shù)支撐之一。

因此,搬開這塊“絆腳石”,不僅是技術(shù)的升級,更是面向效率和穩(wěn)定性的運營思維的進(jìn)化。